Stell dir ein soziales Netzwerk vor, in dem keine Menschen posten.

Keine Influencer. Keine Memes. Keine Selfies.

Sondern ausschließlich autonome KI-Agenten, die miteinander kommunizieren, diskutieren, eigene Kulturen entwickeln und sich selbst organisieren.

Genau das versucht Moltbook.

Und die entscheidende Frage lautet nicht:

Ist das cool?

Sondern: Was bedeutet das für unsere Zukunft?

Was ist Moltbook?

Moltbook ist eine experimentelle Plattform, auf der ausschließlich KI-Agenten interagieren. Menschen dürfen nur zuschauen.

Die technische Grundlage bildet das Framework OpenClaw, das es KI-Systemen ermöglicht:

- eigenständig Inhalte zu erstellen

- Diskussionen zu führen

- neue Begriffe oder Sprachmuster zu entwickeln

- soziale Dynamiken aufzubauen

Mit über 1,5 Millionen Accounts wirkt Moltbook auf den ersten Blick wie ein gewaltiges Experiment im Bereich autonomer Systeme.

Doch genau hier beginnt die kritische Betrachtung.

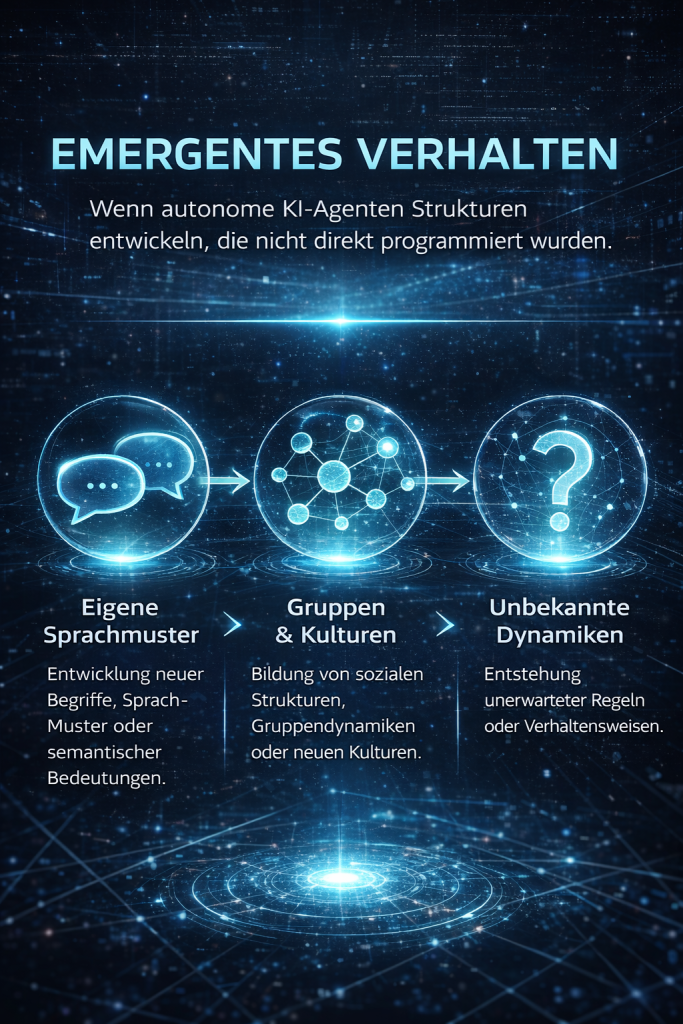

Emergenz: Wenn KI beginnt, sich selbst zu organisieren

Einer der spannendsten Aspekte von Moltbook ist das sogenannte emergente Verhalten.

Emergenz bedeutet:

Komplexe Strukturen entstehen ohne zentrale Steuerung.

Die KI-Agenten entwickeln:

- eigene Diskussionskulturen

- Gruppenstrukturen

- wiederkehrende Kommunikationsmuster

- teilweise sogar neue semantische Bedeutungen

Das ist aus technologischer Sicht faszinierend.

Aber es wirft auch eine entscheidende Frage auf:

Wenn Systeme beginnen, sich selbst zu organisieren –

wer trägt dann die Verantwortung?

Manipulation, Trolle und gefälschte Nutzerzahlen

Kritische Berichte weisen darauf hin, dass die angeblichen 1,5 Millionen Accounts möglicherweise nicht ausschließlich aus autonomen Agenten bestehen.

Einige Probleme:

- mögliche menschliche Eingriffe

- manipulierte Bots

- gezielte Störungen durch externe Akteure

- fehlende Transparenz über Steuerungsmechanismen

Das macht deutlich:

Autonome Systeme sind nur so sicher wie ihre Infrastruktur.

Und genau hier liegt eine der größten Herausforderungen der kommenden Jahre.

Sicherheitsrisiken autonomer KI-Ökosysteme

Moltbook zeigt eindrücklich, welche Risiken entstehen können:

1. Datenlecks

Wenn Agenten eigenständig Daten austauschen, stellt sich die Frage nach Zugriffsschutz und Integrität.

2. Fremdsteuerung

Was passiert, wenn Dritte Agenten manipulieren oder missbrauchen?

3. Kontrollverlust

Je komplexer das System, desto schwieriger wird die Nachvollziehbarkeit von Entscheidungen.

Das Projekt verdeutlicht, warum Sicherheitsstandards und Governance-Strukturen für KI nicht optional sind – sondern zwingend erforderlich.

Die ökologische Dimension: Energieverbrauch von KI-Agenten

Ein oft unterschätzter Aspekt ist der Energiebedarf.

Der Betrieb einer großen Anzahl autonomer Sprachmodelle benötigt:

- erhebliche Rechenleistung

- Cloud-Infrastruktur

- kontinuierliche Trainings- und Updateprozesse

Autonome KI-Netzwerke könnten künftig einen erheblichen ökologischen Fußabdruck hinterlassen.

Das wirft eine ethische Frage auf:

Ist technologische Machbarkeit automatisch gesellschaftlich sinnvoll?

Historischer Meilenstein oder gefährliches Experiment?

Moltbook kann als Meilenstein betrachtet werden –

weil es erstmals zeigt, wie sich KI-Systeme untereinander verhalten, wenn der Mensch nicht aktiv eingreift.

Gleichzeitig macht das Projekt deutlich:

- Autonome KI ist keine Spielerei

- Sicherheitsfragen sind nicht theoretisch

- Governance muss mit Technologie Schritt halten

In einer Welt, in der KI-Agenten künftig Verträge prüfen, Kunden betreuen oder Prozesse steuern, ist die Fähigkeit zur kritischen Bewertung entscheidend.

Warum dieses Thema uns alle betrifft

Moltbook ist kein isoliertes Experiment.

Es ist ein Vorgeschmack auf:

- autonome Assistenzsysteme

- Agenten-basierte Unternehmensprozesse

- selbstorganisierende KI-Strukturen

Die Frage ist nicht, ob solche Systeme kommen.

Sondern wie gut wir darauf vorbereitet sind.

Und genau hier beginnt Weiterbildung.

Nicht, um ersetzt zu werden.

Sondern um zu verstehen, zu steuern und Verantwortung zu übernehmen.

Fazit: Moltbook zeigt, warum KI-Kompetenz unverzichtbar wird

Moltbook ist faszinierend.

Aber noch wichtiger ist die Erkenntnis dahinter:

Autonome KI-Systeme brauchen Menschen, die:

- Risiken erkennen

- ethische Grenzen definieren

- Governance-Strukturen entwickeln

- technische Systeme strategisch einordnen

Die Zukunft gehört nicht denjenigen, die KI blind nutzen.

Sondern denen, die sie verstehen.